最佳开源AI模型刚刚私有化

- 0g_labs

- 发布于 4小时前

- 阅读 16

文章介绍了排名第一的开源AI模型GLM-5,该模型已上线0G Compute的去中心化基础设施。通过可信执行环境(TEE),该平台解决了开源AI模型私有化部署时的数据隐私问题,并提供了与顶级专有模型媲美的性能和显著更低的成本,同时确保了用户提示的隐私和计算的正确性。

最优秀的开源 AI 模型刚刚转为私有

你现在可以在去中心化基础设施上运行排名第一的开源模型,没有人会记录你的提示词。

GLM-5 是一款拥有 7440 亿参数的模型,在 MIT 许可证下发布,在 Artificial Analysis Intelligence Index (49.6) 上总体排名第六,在所有开源模型中排名第一。排在它上面的五款模型都是专有的:Gemini 3.1 Pro、Claude Opus 4.6、Claude Sonnet 4.6、Codex 5.3 和 Claude Opus 4.5。它在智能体工具使用方面得分 98.2%(所有模型中最高,无论是开源还是闭源),并在抗幻觉能力方面处于行业领先地位。

它已在 0G Compute 的主网上线,每百万 token 的输入价格为 1 0G (~$0.60),输出价格为 3.2 0G (~$1.92)。Gemini 3.1 Pro 的收费为 $2.00 / $12.00。Claude Opus 4.6 的收费为 $5.00 / $25.00。

至今无人解决的问题

开源 AI 模型追赶专有模型已有一段时间。权重是免费的。性能是真实的。但是私有运行它们呢?这曾是一个空白。

从 HuggingFace 下载 GLM-5,你仍然需要 GPU。从 AWS 或 Azure 租用,你的提示词会流经别人的服务器。对于处理敏感代码或受监管数据的团队来说,这是不可接受的。

发生了什么变化

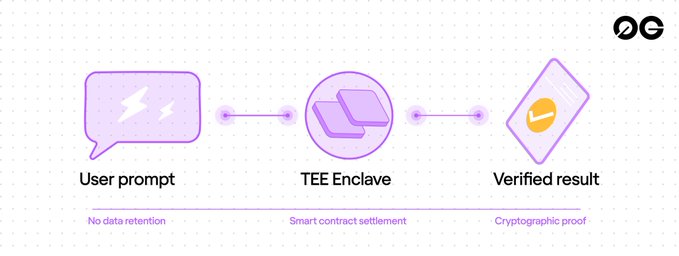

0G Compute 在可信执行环境(TEEs)中运行 GLM-5。TEEs 是硬件隔离的 enclave,即使机器操作员也无法看到正在处理的内容。你的提示词进入,结果出来,中间没有人能访问原始数据。

网络上的提供商在处理后不会保留用户数据。支付通过智能合约托管结算。三种验证方法(TEEML、OPML、ZKML)提供计算正确运行的密码学证明。

目前有六个模型在主网上线。GLM-5 是旗舰模型,每百万输入 token 定价为 1 0G (~$0.60),每百万输出 token 定价为 3.2 0G (~$1.92)。

0G Compute 如何在 TEE enclave 中处理 AI 请求

基准测试说明了真实情况

GLM-5 不仅仅是“对开源来说很好”。在 Intelligence Index 上,它仅次于 Claude Opus 4.6 和 Gemini 3.1 Pro。在 tau2-Bench(智能体工具使用)上,它的得分是所有模型中最高的,无论是开源还是闭源。Codex 5.3 在 Terminal-Bench 上领先,其输出 token 价格为 $14/M。GLM-5 还在 AA-Omniscience Index 上保持着业界最佳的幻觉得分。

在 0G Compute 上,GLM-5 的输出成本仅为专有模型的一小部分。完整的基准测试和定价细分在博客文章中,但简而言之:对于在智能体任务上领先的模型,其成本便宜 84-92%。

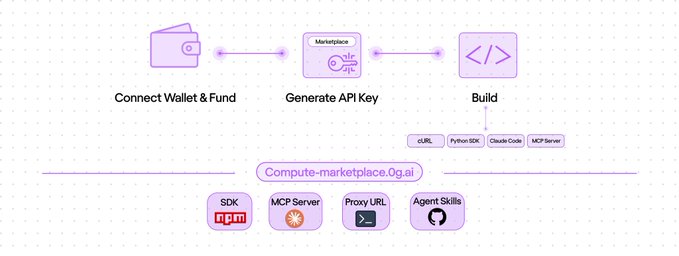

几分钟即可开始

在 compute-marketplace.0g.ai 连接你的钱包,向账户充值 5 0G,并生成一个 API 密钥。然后将其与任何 OpenAI 兼容工具一起使用:

curl https://compute-network-1.integratenetwork.work/v1/proxy/chat/completions \

-H "Authorization: Bearer app-sk-<YOUR_KEY>" \

-d '{"model":"zai-org/GLM-5-FP8","messages":[{"role":"user","content":"Hello"}],"max_tokens":4096}'它适用于 OpenAI Python/JS SDK、Claude Code 代理、MCP 服务器以及 0G Agent Skills 仓库中的 14 种智能体技能。

四种连接到 0G Compute 上 GLM-5 的方式

这对开发者意味着什么

0G Compute 上的 GLM-5 消除了企业 AI 中最古老的权衡:质量与隐私。最优秀的开源模型、经过验证的计算、零数据日志记录,运行在没有任何单一实体控制的基础设施上。

如果你的 AI 不会泄露你的数据,你会构建什么?

- 原文链接: x.com/0g_labs/status/202...

- 登链社区 AI 助手,为大家转译优秀英文文章,如有翻译不通的地方,还请包涵~

- 介绍 EthIQ 36 浏览

- Zero 链: 技术定位报告 56 浏览

- Obol Stack + OpenClaw = ObolClaw:助力代理保障以太坊安全并为其赋能 205 浏览

- 以太坊怎么了? 250 浏览

- 如何去中心化构建区块? 418 浏览

- Vitalik的L2重置:以太坊为何需要此航向修正 386 浏览

- 让挖矿带来更多完全验证的比特币用户 392 浏览

- 从以太坊和索拉纳看 MEV 演进、交易排序的综合博弈 522 浏览

- 超越博物馆的艺术:当网络成为媒介 461 浏览

- 市场主导地位或付费访问不等于中心化 537 浏览

- Vitalik: 2026年我对使用的软件做了两个重大改变 642 浏览