OpenClaw无限免费:如何将你的OpenClaw连接到本地模型(甚至在Mac Mini上)

- alexfinn

- 发布于 23小时前

- 阅读 40

这篇文章介绍了如何通过在本地设备(如Mac Mini)上运行开源AI模型(如Qwen 3.5)来为AI代理(OpenClaw)提供无限、私密且免费的智能服务。文章强调了本地部署AI模型可以节省API费用,解锁新的应用场景,并提供了使用LM Studio设置Qwen 3.5模型的简易步骤,还建议采用混合模型(云端AI规划,本地AI执行)以达到最佳效果。

无限免费的 OpenClaw:如何将你的 OpenClaw 连接到本地模型(甚至在 Mac Mini 上)

1.1K 177K #

未来是本地化的。

现在我的办公桌上有 3 台 Mac Studios 为我的 OpenClaw 提供动力。它们都运行着 Qwen 3.5,这是一个超级智能的本地模型,其性能基本与 Sonnet 4.5 一样好。无限的 tokens,没有速率限制,所有这些都只需支付电脑的电费。

100% 私密。没有任何数据会上传到 AI 公司可以读取或用于训练新模型的云服务器。所有数据都保留在设备上。我可以关闭 Wi-Fi,它仍然可以为我工作。

这就是未来。你自己的个人、私密、无限的超级智能就放在你的桌子上。24/7 为你工作。

但问题是,这不一定是你的未来。它现在就可以是你的现实。你不需要 10,000 美元的 Mac Studios 也能做到。你现在就可以在 Mac Mini 上完成这一切。今天。就是现在。

Qwen 3.5 几天前刚刚发布,它具有革命性意义。Sonnet 4.5 级别的超级智能,但它可以适应 32GB 的内存。

这意味着如果你有一台比基础款更高一级的 Mac Mini,你就可以在其上运行这个本地模型,并在你的桌上获得无限的 Sonnet 4.5 级别智能(这在 6 个月前是革命性的),为你的 OpenClaw 提供 24/7 的动力。

没有限制。没有 Anthropic 会把你踢出去。没有 API 费用。所有都是私密的。

6 个月前的前沿智能。就在你的桌上。持续工作。

这具有革命性意义。

目前,关于 OpenClaw 的最大抱怨是限制和价格。如果你接入 Anthropic API,你每月可能要花费数千美元的费用,并且会不断遇到限制。这解决了这个问题。

它不仅为你节省了成本,还开启了更多使用场景。现在你没有了限制,可以 24/7/365 运行你的智能体。这彻底改变了你与 AI 的关系。

现在,它不再像聊天机器人那样是来回对话,而是一种被动、环境式的关系,你的智能体不断为你创造价值,自我改进,并寻找新的任务。这些都是在使用 API 时不可能实现的事情。

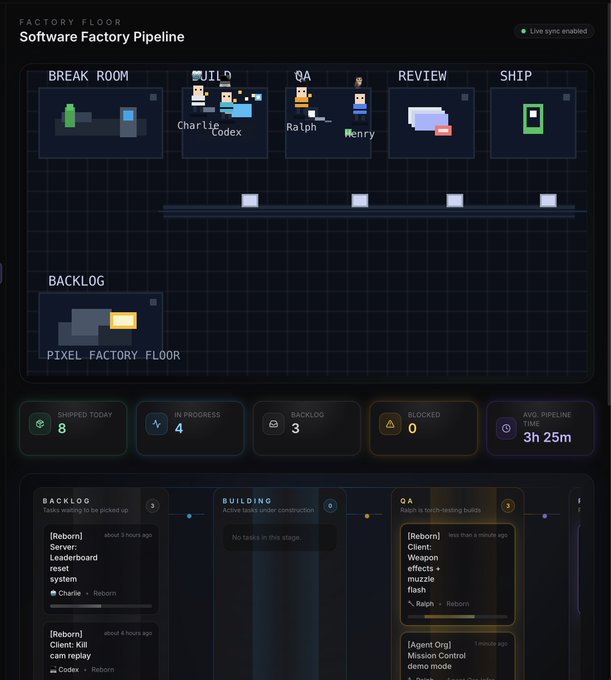

例如:我现在有一个 SaaS 工厂,我的智能体正在其中工作:

4 个 OpenClaw 智能体同步工作在同一个产品上,处理各自的任务。当一个智能体完成一个任务后,它会寻找一个新的任务来处理。如果需要,它可以创建自己的任务。

另一个智能体(Ralph)会对智能体执行的每个任务进行 QA。如果任何智能体出了错,Ralph 会编辑它们的记忆并改进它们。

一个完整的闭环、自我改进系统。如果我使用 API,每月将花费数千美元。使用本地模型(Qwen 和 MiniMax),它是完全免费的(只需电费,这在 Mac 电脑上效率很高)。

解锁了以前从未可能实现的全新用例。赋予了我作为一人公司从未想过会拥有的力量。

你也可以做到这一点。你可以拥有自己的智能体团队持续工作和改进,即使你使用的是 Mac Mini。

启动并运行本地模型

要运行 Qwen 3.5(我们前面讨论的模型),你至少需要一台拥有 32GB 内存的 Mac Mini。该模型只需要 20GB 内存,但你需要一些额外的空间来执行其他任务。

如果你只有基础款 16GB 的 Mac Mini,那也没关系,你将无法运行这个模型,但你仍然可以运行更小的模型。它们不会达到前沿智能水平,但你可以将一些小任务卸载到你的本地模型上。

以下是如何在你的 32GB 内存或更高配置的电脑上设置 Qwen 3.5-35B-A3B:

-

下载 LM Studio — lmstudio.ai ( http://lmstudio.ai/ ),免费,拖放到“应用程序”中。

-

搜索 Qwen3.5-35B-A3B-4bit — 在“Discover”选项卡中,搜索“Qwen3.5-35B-A3B”并选择 4-bit MLX 版本。

-

下载 — 大约 20GB,在网速不错的情况下需要几分钟。

-

加载模型 — 在侧边栏中点击它,点击“Load”。完成。你现在就有一个本地 AI 在运行了。

-

使用它 — 让你的 OpenClaw 连接到它。假设你已将其下载到 LM Studio 中,并且你想将该模型用作工具。

如果你使用的电脑内存小于 32GB,例如基础款 Mac Mini,我建议你与你的 OpenClaw 对话并询问:“我可以在我的硬件上运行哪个最好的本地模型,能够帮助我们分担一些任务或改进我们的记忆系统?”

何时使用它

这个模型是 6-12 个月前的前沿技术,但它不是今天的最前沿。所以我的建议是:将 Anthropic 或 ChatGPT 作为你的 OpenClaw 的“大脑”,然后让它使用你的本地模型作为“肌肉”。

前沿模型会规划一切,然后使用本地模型来执行。

执行占用了 90% 的 token 使用量,因此这会为你节省大量成本。

它为你提供了一个混合模型,这兼顾了两者的最佳优势。

它还让你有机会尝试本地智能,并学习更多关于 AI 的知识。在你需要时,还能保护你的数据隐私。

这也将让你为我所相信的今年即将到来的本地化未来做好准备。

我相信到今年年底,我们将拥有可以在一台 Mac Studio 或 Mac Mini 上运行的 Opus 4.6 级别模型。当这种情况发生时,世界将意识到其中的可能性。

对你来说是好消息:如果你现在就采取行动,你将领先于所有人,这正是巨大机会所在。

- 原文链接: x.com/alexfinn/status/20...

- 登链社区 AI 助手,为大家转译优秀英文文章,如有翻译不通的地方,还请包涵~